標準誤差の一般的な定義

定義 1

ある推定量estimator $T$ について、$T$ の標準偏差の推定値estimateを標準誤差standard errorと言う。 $$ \text{s.e.} \left( T \right) := \sqrt{ \widehat{ \Var \left( T \right) } } $$

説明

定義で統計量ではなくて、正確に推定量と言われた理由がある。僕が当てたいパラメータ $\theta$ と「合ってるかどうか」を議論する時じゃなければ、標準誤差は意味をなさないから、式で$\theta$ が一度も登場しないにしても、わざわざ推定量について定義するんだ。だから$T$ の候補は明らかに標本平均 $\overline{X}$ や回帰係数 $\beta_{k}$ などで、その信頼区間が気になるから$\text{s.e.} \left( T \right)$ が必要になるんだ。

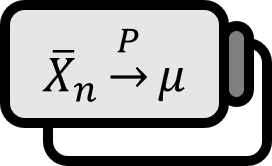

普通は、$\overline{X} = \sum_{k=1}^{n} X_{k}$ の標準誤差 $S / \sqrt{n}$ をこのような定義から学んで、これだけが標準誤差だと思うことが多いけど、実際にはそれも定義ではなくて、計算を通じて得られる公式なんだ。できるだけ省略せずに計算してみよう。 $$ \begin{align*} \text{s.e.} \left( \overline{X} \right) =& \sqrt{ \widehat{ \Var \left( \overline{X} \right) } } \\ =& \sqrt{ \widehat{ \Var \left( {{ 1 } \over { n }} \sum_{k=1}^{n} X_{k} \right) } } \\ =& \sqrt{ \widehat{ {{ 1 } \over { n^{2} }} \Var \left( \sum_{k=1}^{n} X_{k} \right) } } \\ \overset{\text{iid}}{=} & \sqrt{ \widehat{ {{ 1 } \over { n^{2} }} \sum_{k=1}^{n} \Var \left( X_{k} \right) } } \\ =& \sqrt{ {{ 1 } \over { n^{2} }} \sum_{k=1}^{n} \widehat{ \Var \left( X_{k} \right) } } \\ =& \sqrt{ {{ 1 } \over { n^{2} }} \sum_{k=1}^{n} S^{2} } \\ =& \sqrt{ {{ 1 } \over { n^{2} }} n S^{2} } \\ =& \sqrt{ {{ 1 } \over { n }} S^{2} } \\ =& {{ 1 } \over { \sqrt{n} }} S \end{align*} $$ 見ての通り、推定量estimatorと推定値estimateが違っていて、こんな簡単な例でもかなり混乱する。そこに、実際に標準誤差を使う多くの場面で、標本分散を自由度で割ってルートを取る形を多用するから、その形を標準誤差そのものと間違えやすい。しかし、そのような直感がよく通じるとしても、標準誤差はそのような方法で決まるものではなく、上に示したような数式的な展開で導出するのが正しいんだ。

Hadi. (2006). Regression Analysis by Example(4th Edition): p33. ↩︎