충분통계량

정의

수식적인 정의 1

모수 $\theta \in \Theta$ 에 대해 랜덤 샘플 $X_{1} , \cdots , X_{n}$ 의 확률질량/밀도함수를 $f(x;\theta)$, 통계량 $Y_{1} := u_{1} \left( X_{1} , \cdots , X_{n} \right)$ 의 확률질량/밀도함수를 $f_{Y_{1}} \left( y_{1}; \theta \right)$ 이라 하자.

$\theta \in \Theta$ 에 종속되지 않은 $H \left( x_{1} , \cdots , x_{n} \right)$ 에 대해 $$ {{ f \left( x_{1} ; \theta \right) \cdots f \left( x_{n} ; \theta \right) } \over { f_{Y_{1}} \left( u_{1} \left( x_{1} , \cdots, x_{n} \right) ; \theta \right) }} = H \left( x_{1} , \cdots , x_{n} \right) $$ 이면 $Y_{1}$ 을 $\theta$ 에 대한 충분통계량sufficient statistic이라 한다.

일반적인 정의 2

통계량 $T(\mathbf{X})$ 가 주어진 샘플 의 $\mathbf{X}$ 조건부 확률 분포가 모수 $\theta$ 에 종속되지 않으면 $T(\mathbf{X})$ 를 $\theta$ 에 대한 충분통계량이라 한다.

설명

정의의 수식이 의미하는 것은 직관적으로 보았을 때 분자와 분모에서 $\theta$ 가 캔슬된다는 것―충분통계량 $Y_{1}$ 이 랜덤샘플 $X_{1} , \cdots , X_{n}$ 의 정보를 정확하게 물고 있다는 의미가 될 것이다. 충분통계량의 ‘충분’이란 $\theta$ 에 대해 가진 정보가 ‘충분’하다 정도로 받아들이면 되고, 충분통계량이 빠진 후에는 $\theta$ 에 대한 정보가 전혀 남아있지 않아야한다.

예시로써 충분통계량을 이해하기 위해 다음의 정리를 사용하자.

네이만 인수분해 정리: 랜덤 샘플 $X_{1} , \cdots , X_{n}$ 이 모수 $\theta \in \Theta$ 에 대해 같은 확률질량/밀도함수 $f \left( x ; \theta \right)$ 를 가진다고 하자. 통계량 $Y = u_{1} \left( X_{1} , \cdots , X_{n} \right)$ 이 $\theta$ 의 충분통계량인 것은 다음을 만족하는 음이 아닌 두 함수 $k_{1} , k_{2} \ge 0$ 이 존재하는 것이다. $$ f \left( x_{1} ; \theta \right) \cdots f \left( x_{n} ; \theta \right) = k_{1} \left[ u_{1} \left( x_{1} , \cdots , x_{n} \right) ; \theta \right] k_{2} \left( x_{1} , \cdots , x_{n} \right) $$ 단, $k_{2}$ 는 $\theta$ 에 종속되지 않아야한다.

와닿지 않는 예시

$$ X_{1} , \cdots , X_{n} \sim N \left( \mu , \sigma^{2} \right) $$

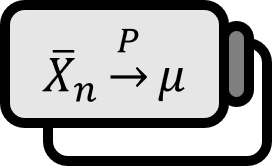

경험적으로 충분통계량은 왜 이런 걸 구하는지 이해하지 못하는 것에서 시작해야 이해할 수 있었다. 대표적으로 와닿지 않는 예시로써 위와 같이 정규분포 $N \left( \mu , \sigma^{2} \right)$ 의 모평균 $\mu$ 에 대한 충분통계량을 보는 것이다. 인수분해 정리에 따르면 $\mu$ 의 충분통계량은 $$ \begin{align*} \prod_{k=1}^{n} f \left( x_{k} ; \mu \right) =& \prod_{k=1}^{n} {{ 1 } \over { \sigma \sqrt{2 \pi} }} \exp \left( - {{ \left( x_{i} - \mu \right)^{2} } \over { 2 \sigma^{2} }} \right) \\ =& \left( {{ 1 } \over { \sigma \sqrt{2 \pi} }} \right)^{n} \exp \left( - \sum_{k=1}^{n} {{ \left( x_{i} - \mu \right)^{2} } \over { 2 \sigma^{2} }} \right) \\ =& \left( {{ 1 } \over { \sigma \sqrt{2 \pi} }} \right)^{n} \exp \left( - \sum_{k=1}^{n} {{ x_{i}^{2} } \over { 2 \sigma^{2} }} \right) \exp \left( - \sum_{k=1}^{n} {{ \left( 2 x_{i} - \mu^{2} \right) } \over { 2 \sigma^{2} }} \right) \\ =& \left( {{ 1 } \over { \sigma \sqrt{2 \pi} }} \right)^{n} \exp \left( - \sum_{k=1}^{n} {{ x_{i}^{2} } \over { 2 \sigma^{2} }} \right) \cdot \exp \left( - {{ 1 } \over { \sigma^{2} }} \sum_{k=1}^{n} x_{i} + {{ n(\mu/\sigma)^{2} } \over { 2 \ }} \right) \\ =& k_{2} \left( x_{1} , \cdots , x_{n} \right) \cdot k_{1} \left[ u_{1} \left( x_{1} , \cdots , x_{n} \right) ; \mu \right] \end{align*} $$ 이므로 표본합 $\sum_{k=1}^{n} X_{k}$ 이든 분자 분모에 $n$ 을 곱해서 표본평균 $\overline{X}$ 가 되든 상관 없다. 어찌되든 우리의 직관대로 $\mu$ 의 충분통계량으로써 그 불편추정량이면서 일치추정량이면서 최대우도추정량인 표본평균이 나온 것까진 좋다. 수식적으로는 무슨 말인지 알겠다. 그런데 뭐 어쩌란건지, 영 감이 잡히지 않을 것이다.

와닿는 예시

$$ X_{1} , \cdots , X_{n} \sim U (0,\theta) \text{ with } f \left( x ; \theta \right) = \begin{cases} 1 & , \text{if } x \in (0,\theta) \\ 0 & , \text{otherwise} \end{cases} = {{ 1 } \over { \theta }} I_{(0,\theta)} (x) $$

가령 최대값의 모수가 $\theta$ 인 유니폼분포에서 얻은 랜덤 샘플을 생각해보자. 실제 그 실현이 $$ \begin{bmatrix}2.3 \\ 1.2 \\ 1.7 \\ 0.1 \\ 1.1\end{bmatrix} $$ 이고 더 이상의 샘플을 얻을 수 없다면, 균등분포 $U(a,b)$ 의 모평균이 ${{ b+a } \over { 2 }}$ 기 때문에 다음과 같은 추정량을 생각해볼 수 있다. $$ {{ \hat{\theta} + 0 } \over { 2 }} = {{ \sum_{k} x_{k} } \over { n }} \implies \hat{\theta} \overset{?}{=} {{ 2 \sum_{k} x_{k} } \over { n }} $$ 수리통계적으로 썩 나쁘지 않은 추측같다. 실제로 위 데이터로 계산한 표본평균의 $2$배는 $2.16$ 으로 꽤 그럴싸한데, 생각해보면 $2.3$ 이 샘플에 있으므로 $\theta = 2.16$ 일 리가 없다. 때려죽여도 $\theta$ 가 $2.3$ 보다는 크거나 같아야할 것이고, 직관적으로 보아 $\theta$ 에 대한 합리적 추정은 그냥 간단히 $\hat{\theta} = 2.3$ 이 될 수 있다. 그보다 큰 샘플을 얻을 리가 없다는 게 아니라, 지금 샘플을 보았을 때 딱히 $2.3$ 보다 크게 생각할 이유가 하등 없기 때문이다. 이제 실제로 충분통계량을 찾아보자.

지시함수의 곱: $$ \prod_{i=1}^{n} I_{(-\infty, \theta]} \left( x_{i} \right) = I_{(-\infty, \theta]} \left( \max_{i \in [n]} x_{i} \right) $$

이 보조정리와 인수분해 정리에 따라 생각해보면 $\theta$ 에 대한 충분통계량은 $$ \begin{align*} \prod_{k=1}^{n} f \left( x_{k} ; \mu \right) =& \prod_{k=1}^{n} {{ 1 } \over { \theta }} I_{(0,\theta)} \left( x_{k} \right) \\ = & {{ 1 } \over { \theta^{n} }} I_{(0,\theta)} \left( \max x_{k} \right) \cdot 1 \\ = & k_{1} \left[ u_{1} \left( x_{1} , \cdots , x_{n} \right) ; \theta \right] k_{2} \left( x_{1} , \cdots , x_{n} \right) \end{align*} $$ 이므로 표본의 최대값 $\max_{k} X_{k} = X_{(n)}$ 이 될 수 있다. 이것이 의미하는 것은 말 그대로 $\theta$ 에 대한 정보를 생각할 때 여타 다른 샘플은 필요 없고, $\max_{k} X_{k}$ 만 생각하면 ‘충분’하다는 것이다.

이러한 아이디어는 데이터 많이 뽑아서 모수 찍고 어디로 근사시키고 하는 사고방식과는 아예 궤를 달리한다. 언뜻 직관뿐인 단순 추측에 대해 수리와 형식으로써 접근하는 통계적 추론이고, 이를 통해 한 단계 더 깊은 통계학의 세계로 들어설 수 있다.

최소충분통계량

우리는 와닿는 예시에서 $\max_{k} X_{k}$ 이 $\theta$ 에 대한 충분통계량임을 직관과 비교해서 확인했다. 딱봐도 이보다 더 좋은 충분통계량은 없어보이는데, 최소충분통계량에 대한 논의가 그 답이 될 수 있을 것이다.

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!