ベイズの定理の証明と事前分布、事後分布

定理 1

標本空間 $S$ と事象 $A$、確率 $P$ $\left\{ S_1, S_2, \cdots ,S_n \right\}$ が $S$ の分割だとすると、次が成り立つ。 $$ P(S_k|A)=\frac { P(S_k)P(A|S_k) }{ \sum _{ k=1 }^{ n }{ P(S_k)P(A|S_k) } } $$

定義

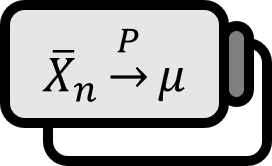

ベイズ定理の右辺である$P \left( S_{k} \right)$を事前確率prior Probability、左辺にあたる$P \left( S_{k} | A \right)$を事後確率posterior Probabilityと呼ぶ。これらの確率で構成される確率分布をそれぞれ事前分布prior distribution、事後分布posterior distribution

説明

またベイズ法則Bayes’ ruleとも呼ばれるこの定理は、二つの法則だけで簡単に証明できるが、その応用は広大だ。いわゆるベイジアンパラダイムは、統計学を二分する思考法であり、その重要性は何度強調しても過言ではない。

私たちが知りたいのは上式の左辺だ。既に知っているのは事象 $A$ と標本空間 $S$ の分割 $S_k$ が起こる確率、そしてそれぞれの分割が起こったときに $A$ が起こる確率だ。つまり、$S_k$とそれらが $A$ に与える影響についてすべて知っている状態から始める。ベイズの定理はここから反対に、$A$がそれぞれにどんな影響を与えるかを知ることができる定理だ。難しいと感じるなら、ただ左辺が知りたいということだけ考えても良い。

証明

全確率の法則と確率の乗法定理によって、以下の式を得る。 $$ \begin{align*} P(A)=&P(A\cap S_1)+P(A\cap S_2)+…+P(A\cap S_n) \\ =&P(S_1)P(A|S_1)+P(S_2)P(A|S_2)+…+P(S_n)P(A|S_n) \\ =& \sum _{ k=1 }^{ n }{ P(S_k)P(A|S_k) } \end{align*} $$ 両辺に逆数を取ると $$ \begin{align*} & \frac { 1 }{ \sum _{ k=1 }^{ n }{ P(S_k)P(A|S_k) } }=\frac { 1 }{ P(A) } \\ \implies& \frac { P(A\cap S_k) }{ \sum _{ k=1 }^{ n }{ P(S_k)P(A|S_k) } }=\frac { P(A\cap S_k) }{ P(A) } \\ \implies& \frac { P(S_k)P(A|S_k) }{ \sum _{ k=1 }^{ n }{ P(S_k)P(A|S_k) } }=P(S_k|A) \end{align*} $$

■

Hogg et al. (2013). Introduction to Mathematical Statistcs(7th Edition): p23. ↩︎