수리통계학에서의 기대값, 평균, 분산, 적률의 정의

정의: 기대값, 평균, 분산

확률 변수 $X$ 가 주어져 있다고 하자.

연속 확률 변수 $X$ 의 확률 밀도 함수 $f(x)$ 가 $\displaystyle \int_{-\infty}^{\infty} |x| f(x) dx < \infty$ 를 만족하면 다음과 같이 정의된 $E(X)$ 를 $X$ 의 기대값expectation이라고 한다. $$ E(X) := \int_{-\infty}^{\infty} x f(x) dx $$

이산 확률 변수 $X$ 의 확률 질량 함수 $p(x)$ 가 $\displaystyle \sum_{x} |x| p(x) < \infty$ 를 만족하면 다음과 같이 정의된 $E(X)$ 를 $X$ 의 기대값expectation이라고 한다. $$ E(X) := \sum_{x} x p(x) $$

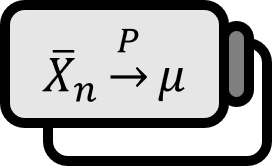

$\mu = E(X)$ 이 존재하면 $X$ 의 평균mean이라고 정의한다.

$\sigma^2 = E((X - \mu)^2)$ 이 존재하면 $X$ 의 분산variance으로 정의한다.

추상화의 의미

통계학을 단 한마디 쉬운 말로 줄이자면 ‘그래서 평균적으로 어떤데?‘를 연구하는 학문이라고도 할 수 있겠다. ‘평균’은 대푯값으로써 상당히 상식적이면서도 구하기도 쉬운 통계량이다. 물론 이 세상에 있는 여러가지 현상을 설명하려면 그렇게 간단한 수준만으로는 부족해 ‘기댓값’이라는 형태로 추상화된다. 기댓값은 이산 분포뿐만 아니라 구분구적법의 발상을 빌려 연속 분포에도 대응하는 개념이 된다. 이 글에서 논할 것이 바로 그 ‘추상화’에 대한 이야기다.

수리통계학은 분명 통계 이론에 대한 내용을 담고 있지만 학문의 성격을 봤을 때 본질적으로 수학의 한 분야에 더 가깝다. 따라서 여타 수학의 갈래처럼 수학자와 같은 마인드로 수리통계학을 이해하려고 하는 노력이 필요하다. 수학자의 일 중 하나는 직관 혹은 이미 세상에 나온 이론과 충돌하지 않되 엄밀한 정의를 고안해서 삼라만상의 모든 현상과 객체, 혹은 그조차도 초월한 모든 것들을 기호로 바꾸고 앉은 자리에서 그 모든 것들을 연구할 수 있도록 하는 것이다.

평균과 분산의 정의를 보면 직관적인 의미는 전혀 남아있지 않고 그저 확률변수에 기댓값을 취한 형태로 나타난다. 정의에서 저들이 어떻게 평균과 실제로 연결되는지, 어떻게 분산이랑 실제로 연결되는지는 관심밖의 일이다. 오히려 평균과 분산이라는 개념을 뼛속까지 당연하게 여길만큼 숙달된 학습자가 역으로 기호에 적응하는 것이다. 실제로 수리통계학을 공부할 정도의 학습자라면 저러한 정의에 큰 의문은 갖지 않을 것이다.

평균의 추상화와 함께 기댓값이라는 개념이 자리를 잡자 학자들은 더 많은 가능성을 발견한다. 단순 합계나 적분 같은 한계를 넘어 기초적인 대수학이나 해석학의 이론을 도입해서 이들을 다루기 시작한 것이다. 자연스럽게 학자들의 관심은 추상화에서 일반화로 넘어간다.

정의: 적률

자연수 $m$ 에 대해 $E( X^m )$ 을 $X$ 의 $m$번째 적률$m$th Moment이라고 정의한다.

일반화의 의미

적률의 정의를 읽어보는 것만으로도 즉시 알 수 있는 사실은 첫번째 적률, 즉 $E(X^1)$ 이 $X$ 의 평균이 된다는 것이다. 거기서 조금 더 생각해보면 두번째 적률인 $E(X^2)$ 역시 약간의 조작을 통하면 분산이 된다는 것도 알 수 있다.

평균은 첫번째 적률, 분산은 두번째 적률과 사실상 같은 개념으로 볼 수 있는 것이다. 거꾸로 생각해보면 적률들 중에 첫번째가 평균에 대응되고 두번째가 분산에 대응된다고 할 수 있다.

그렇다면 직관을 가진 학자들은 당연히 세번째나 네번째 적률 역시 무언가 중요한 정보를 줄 수 있다는 추측을 할 것이다. [ NOTE: 구체적으로 이것을 왜도, 첨도라고 한다. ] 이제는 연구의 방향이 반대가 되어 밝혀진 사실을 이론으로 설명하는 게 아니라 이론으로 숨겨진 사실을 찾아내려 하는 것이다.

이러한 방법론은 통계학뿐만 아니라 자연과학 전반에서 쉽게 찾아볼 수 있다. 수리통계학이 통계보다는 수학에 가깝다고 했지만, 학문의 존재의의에 가까이 다가서면 또 다시 통계학의 모습을 되찾는 것이다. 적률moment이라는 단어 자체는 물리학 등에서도 사용되지만 통계학에선 구체적으로 적률이 어떤 의미를 가진다고 생각할 필요가 없다. 그저 수리통계학을 지탱하는 이론을 설명할 때 사용하는 단어일 뿐으로 알아두면 충분하다.

한편 기대값의 존재 조건에서 $\displaystyle \int_{-\infty}^{\infty} |x| f(x) dx < \infty$, 즉 $x$ 에 굳이 절대값을 취할 필요가 있는지 의문이 들 수 있다. 존재성을 보장하는 것과 구체적인 값을 계산하는 것이 다를 수 있다는 것은 둘째치더라도 $X$ 의 기대값 $E(X)$ 는 굳이 다른 식을 쓸 필요가 없어 보이기 때문이다.

이에 대해서는 다음의 정리를 보면 조금 도움이 될지도 모르겠다. 가장 간단한 $X$ 에 대한 논의가 아니라 $g(X)$ 로의 일반화까지 염두에 둔다면, 오히려 $E(X)$ 야말로 항등함수 $g(x) = x$ 에 대한 특수한 경우로 정의되었다고 볼 수도 있을 것이다.

정리

확률변수 $X$ 에 대해 $Y$ 가 어떤 함수 $g$ 에 대해 $Y := g(X)$ 와 같이 나타난다고 하자.

- [1]: $X$ 가 확률밀도함수 $f_{X}$ 를 가지는 연속확률변수고 $\displaystyle \int_{-\infty}^{\infty} |g(x)| f_{X} (x) dx < \infty$ 이면 $$ E (Y) = \int_{-\infty}^{\infty} g(x) f_{X} (x) dx $$

- [2]: $X$ 가 확률질량함수 $p_{X}$ 를 가지는 이산확률변수고 $\displaystyle \sum_{x} |g(x)| p_{X} (x) < \infty$ 이면 $$ E (Y) = \sum_{x} g(x) p_{X} (x) $$

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!