완비통계량

정의 1

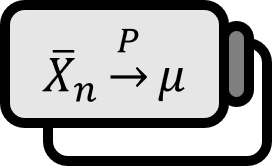

$\Omega$ 를 모수의 집합이라고 하자. 샘플 $\mathbf{X}$ 의 통계량 $T := T \left( \mathbf{X} \right)$ 의 확률밀도함수 혹은 확률질량함수 $f \left( t ; \theta \right)$ 들을 모아놓은 패밀리 $\left\{ f \left( t ; \theta \right) : \theta \in \Theta \right\}$ 가 $$ \forall \theta, E_{\theta} g (T) = 0 \implies \forall \theta, P_{\theta} \left( g(T) = 0 \right) = 1 $$ 를 만족하면 컴플리트complete하다고 말하고, $T \left( \mathbf{X} \right)$ 를 완비통계량complete statistic이라 한다.

설명

말로 발음할 때는 보조통계량을 아무도 한국어로 말하지 않고 [앵실러리 스태티스틱]이라 하듯, 보통 완비통계량 역시 영어 발음 그대로 [컴플리트 스태티스틱]이라 한다.

주의사항

주의해야할 점으로는 컴플리트라는 것이 어떤 특정한 확률분포가 아닌 분포족, 즉 모든 $\theta$ 에 대해 $\left\{ f \left( t ; \theta \right) : \theta \in \Theta \right\}$ 를 생각한다는 것이고 그 때 $T$ 를 완비통계량이라 부른다는 것이다. 더 명료하게 요약하면 다음과 같다:

- 컴플리트 한 것은 분포족 $\left\{ f \left( t ; \theta \right) : \theta \in \Theta \right\}$ 이다.

- 완비통계량 자체는 그 분포족이 아닌 통계량 $T$ 다.

그런데 요약을 보면 $g$ 는 등장하지 않는다. 완비통계량의 정의가 뜬구름 잡는 소리로 느껴지는 이유는 이렇게 $g$ 가 무엇이고 $T$ 가 무엇인지 도대체 알 수가 없기 때문이다. 거기에 ‘모든 $\theta$’ 라는 표현이 마침표를 찍어준다.

상식적인 통계량

간단한 직관으로 접근해보자. 기대값이 $0$ 이 되도록 한다는 $g(T)$ 의 설명은 잠시 제쳐두고, 그냥 두 기대값 $E_{\theta} g_{1} (T)$ 과 $E_{\theta} g_{2} (T)$ 이 같은 상황을 생각해보자. 이들을 적분꼴로 나타내보면 $$ \int_{\mathbb{R}} g_{1} \left( t \right) f \left( t ; \theta \right) d t = E_{\theta} g_{1} (T) = E_{\theta} g_{2} (T) = \int_{\mathbb{R}} g_{2} \left( t \right) f \left( t ; \theta \right) d t $$ 이다. [ NOTE: 실제 계산에서 $T$ 는 적분변수 $dt$ 로써 의미가 있고, 그 통계량 본질에 대한 특징은 $f \left( t ; \theta \right)$ 에 녹아들어 있다. ] 그런데 $f \left( t ; \theta \right)$ 는 확률밀도함수기 때문에 $f \left( t ; \theta \right) \ne 0$ 일테고, 그럼에도 위 등식이 성립한다는 것은 아마 $g_{1}$ 과 $g_{2}$ 가 같다는 의미일 것이다. 물론 $\theta$ 에 따라 바뀌는 확률밀도함수의 형태에 맞춰서 그때그때 새로운 $g_{1} \ne g_{2}$ 를 선택함으로써 등식을 만족시킬 수는 있겠지만, 이것이 모든 $\theta$ 에 대해 항상 성립한다면 $g_{1}$ 과 $g_{2}$ 에는 많은 선택지가 없다. 아마도 거의 모든 $t$ 에서 다음이 성립해야할 것이다. $$ g_{1} \left( t \right) = g_{2} \left( t \right) $$ 이를 다시 말하면 $g_{1}$ 과 $g_{2}$ 는 거의 확실히 같은 함수, 즉 점 몇개 빠지는 정도는 빼고 모두 같을 확률이 $100\% $ 인 것이다. 이 말을 그냥 수식으로 나타내보면 $$ P_{\theta} \left( g_{1} \left( T \right) = g_{2} \left( T \right) \right) = 100 \% $$ 이다. 물론 이는 어디까지나 $E_{\theta} g_{1} (T) = E_{\theta} g_{2} (T)$ 일 때의 이야기이므로, $$ \forall \theta \in \Theta, E_{\theta} g_{1} (T) = E_{\theta} g_{2} (T) \implies \forall \theta \in \Theta , P_{\theta} \left( g_{1} \left( T \right) = g_{2} \left( T \right) \right) = 100 \% $$ 다. 이제 다시 $g$ 로 돌아가 $g := g_{2} - g_{1}$ 라 두면, 아까까진 정말 어색했던 완비통계량의 정의를 얻는다. 정의에서 이러한 설명을 모두 생략하고 대뜸 $g$ 부터 시작하는 이유는 이러한 개념을 표현하기 위해 $g_{1}$ 과 $g_{2}$ 가 반드시 필요하지가 않기 때문이다. [ NOTE: 교재에 따라서는 불편추정량 등과 연관지어 설명하기도 하는데, 이 역시 완비통계량의 정의 자체에는 필요가 없다. ] $$ \forall \theta, E_{\theta} \left[ g_{2} (T) - g_{1} (T) \right] = 0 \implies \forall \theta, P_{\theta} \left( \left[ g_{2} (T) - g_{1} (T) \right] = 0 \right) = 100 \% $$

만약 $T$ 가 완비통계량이 아니라면 위에서 그냥 쉽게 말하고 넘어갔던 $f \left( t ; \theta \right)$ 에 큰 문제점이 있을 것으로 짐작할 수 있다. 어떤 $\theta$ 에 대해서는 기상천외하고 변화무쌍하게 변하게끔 하는 확률밀도함수 $f \left( t ; \theta \right)$ 를 갖는 통계량 $T$ 는 어떻게 봐도 비상식적이다.

지금까지의 논의를 읽어보면 알겠지만 완비통계량은 딱히 어떤 좋은 성질을 보여주지 않았다. 오히려 너무 당연하고 상식적인데, 만약 위 명제에서 단 하나의 $\theta$ 라도 예외가 있다면 $T$ 는 어떤 당연하고 상식적인 이론 전개에 있어서 완전히 준비되지는 않은 통계량으로 생각할 수 있는 것이다.

요약

헷갈렸던 $g, T, \theta$ 에 대한 내용을 한줄씩으로 요약하면 다음과 같다:

- $g$: 솔직히 $0$ 이 될테니 $0$ 외에는 고민할 필요가 없고, 일단 $g(t)$ 로 두면 된다.

- $T$: 언뜻 수식에서 사라진걸로 보이지만, 사실 $f \left( t ; \theta \right)$ 그 자체다.

- $\forall \theta$: 단 하나의 예외적인 $\theta$ 도 허용하지 않는다는 점에서 완비성completeness이 된다.

보편적인 완비성과의 연관성

조금 어려운 이야기다. 오롯이 통계학에만 관심있다면 이하의 내용은 몰라도 된다. 읽고 이해가 되더라도 학계의 정론은 아닌 필자의 개인적인 견해니까 너무 진지하게 받아들이진 말자.

수리통계가 아닌 보통의 수학에서 완비성이라 함은 보통 거리공간에서 정의되는 완비성을 말한다. 코시 시퀀스가 수렴하는 점들이 원래의 공간에 속하는지의 여부가 수학에서 굉장히 중요한데, 측도공간 같은 곳에서는 굳이 코시 시퀀스를 정의하지 않고 완비성을 논하기도 한다. $$ p: x \overset{?}{\triangle} X \implies q: x \in X $$ 그러나 완비성을 말할땐 그 세세한 정의가 어떻게 되든, $\overset{?}{\triangle}$ 가 어떤 관계든 조건부 명제의 $q$ 에는 $x \in X$ 과 비슷한 무언가가 온다. 다른 게 무엇이 되었든, 얼마나 추상화되었든 우리가 관심을 두는 무언가가 원래 집합에 속한다는 것이 보편적인 완비성의 형태인 것이다.

필자는 오랫동안 많은 학자에게 이에 대해 질문하고 위키피디아를 포함한 여러가지2 문서3들을 찾아보았으나, 통계량의 완비성과 그 보편적인 완비성과는 정확한 관련이 없는 것으로 결론을 내렸다. 그나마 마음이 편해지려면 위에서 말한 것처럼 어떤 $\theta$ 에도 예외를 두지 않는다는 점에서 완비통계량 $T$ 에 대해서는 우리가 관심을 가지는 모든 $\theta$ 가 모수의 집합에 들어와 $\theta \in \Theta$ 라는 식으로 말을 지어내서 엮는 수밖에 없다.

그나마 수식적으로 비슷하게라도 생긴 건 측도론에서 말하는 시그마필드의 완비성이 있긴하다4. 여기에 대해서는 나중에 기회가 되고 생각이 나면 다룰지도 모르겠다.

Casella. (2001). Statistical Inference(2nd Edition): p285. ↩︎

https://stats.stackexchange.com/questions/53107/meaning-of-completeness-of-a-Statistic ↩︎

https://mathworld.wolfram.com/CompleteOrthogonalSystem.html ↩︎

Capinski. (1999). Measure, Integral and Probability: p40. ↩︎

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!