라오-크래머 하한

정리 1

정칙조건:

- (R0): 확률밀도함수 $f$ 는 $\theta$ 에 대해 단사다. 수식으로는 다음을 만족시킨다. $$ \theta \ne \theta ' \implies f \left( x_{k} ; \theta \right) \ne f \left( x_{k} ; \theta ' \right) $$

- (R1): 확률밀도함수 $f$ 는 모든 $\theta$ 에 대해 같은 서포트를 가진다.

- (R2): 참값 $\theta_{0}$ 는 $\Omega$ 의 내점interior point이다.

- (R3): 확률밀도함수 $f$ 는 $\theta$ 에 대해 두 번 미분가능하다.

- (R4): 적분 $\int f (x; \theta) dx$ 은 적분 기호를 넘나들며 $\theta$ 에 대해 두 번 미분가능하다.

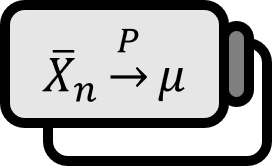

모수 $\theta$ 에 대해 확률밀도함수가 $f(x; \theta)$ 인 랜덤 샘플 $X_{1}, \cdots , X_{n}$ 이 주어져있고 정칙조건 (R0)~(R4)를 만족시킨다고 하자. 통계량 $Y := u \left( X_{1} , \cdots , X_{n} \right)$ 이 $E(Y) = k(\theta)$ 면 $$ \Var (Y) \ge {{ \left[ k’(\theta) \right]^{2} } \over { n I (\theta) }} $$ 이다. 이 때 우변의 ${{ \left[ k’(\theta) \right]^{2} } \over { n I (\theta) }}$ 을 라오-크래머 하한rao-Cramér Lower Bound이라 한다.

- $nI(\theta)$ 는 사이즈 $n$ 인 랜덤샘플의 피셔 정보다.

증명

연속형인 경우에 대한 증명이지만 이산형일때도 별로 다를 게 없다.

$k(\theta) = E(Y)$ 을 적분꼴로 풀어 적어보면 $$ k(\theta) = \int_{\mathbb{R}} \cdots \int_{\mathbb{R}} u \left( x_{1}, \cdots , x_{n} \right) f \left( x_{1}; \theta \right) \cdots f \left( x_{n}; \theta \right) d x_{1} \cdots d x_{n} $$ 양변을 $\theta$ 로 미분하면 $f$ 를 $\theta$ 에 대한 함수로 보면 로그함수의 미분법에서 $\displaystyle \log g = {{ g' } \over { g }}$ 이므로 $$ \begin{align*} k’(\theta) =& \int_{\mathbb{R}} \cdots \int_{\mathbb{R}} u \left( x_{1}, \cdots , x_{n} \right) \left[ \sum_{k=1}^{n} {{ 1 } \over { f \left( x_{k} ; \theta \right) }} {{ \partial f \left( x_{k} ; \theta \right) } \over { \partial \theta }} \right] \\ & \times f \left( x_{1}; \theta \right) \cdots f \left( x_{n}; \theta \right) d x_{1} \cdots d x_{n} \\ =& \int_{\mathbb{R}} \cdots \int_{\mathbb{R}} u \left( x_{1}, \cdots , x_{n} \right) \left[ \sum_{k=1}^{n} {{ f ' } \over { f }} \right] \\ & \times f \left( x_{1}; \theta \right) \cdots f \left( x_{n}; \theta \right) d x_{1} \cdots d x_{n} \\ =& \int_{\mathbb{R}} \cdots \int_{\mathbb{R}} u \left( x_{1}, \cdots , x_{n} \right) \left[ \sum_{k=1}^{n} {{ \partial \log f \left( x_{k} ; \theta \right) } \over { \partial \theta }} \right] \\ & \times f \left( x_{1}; \theta \right) \cdots f \left( x_{n}; \theta \right) d x_{1} \cdots d x_{n} \end{align*} $$ 이제 새로운 확률변수 $\displaystyle Z := \sum_{k=1}^{n} {{ \partial \log f \left( x_{k} ; \theta \right) } \over { \partial \theta }}$ 를 정의하면 위 식은 다음과 같이 깔끔하게 정리된다. $$ k’(\theta) = E(YZ) $$

제1바틀렛 항등식: $$ E \left[ {{ \partial \log f ( X ; \theta ) } \over { \partial \theta }} \right] = 0 $$

피셔 정보의 분산 꼴: $$ \Var \left( {{ \partial \log L ( \theta ; \mathbf{X} ) } \over { \partial \theta }} \right) = n I (\theta) $$

여기서 $Z$ 는 스코어 함수의 합이므로, 바틀렛 항등식과 피셔 정보의 분산꼴에 따라 $$ \begin{align*} E(Z) =& 0 \\ \Var(Z) =& n I (\theta) \end{align*} $$ 이에 따라 $k’(\theta)$ 를 공분산 꼴로 풀어내면 $Y,Z$ 의 표준편차 $\sigma_{Y}, \sigma_{Z}$ 와 피어슨 상관계수 $\rho$ 에 대해 $$ \begin{align*} k’(\theta) =& E(YZ) \\ =& E(Y)E(Z) + \rho \sigma_{Y} \sigma_{Z} \\ =& E(Y) \cdot 0 + \rho \sigma_{Y} \sqrt{n I(\theta)} \end{align*} $$ 양변을 제곱하고 $\rho^{2}$ 에 대해 정리하면 $$ {{ \left[ k’(\theta) \right]^{2} } \over { \sigma_{Y}^{2} n I (\theta) }} \le \rho^{2} $$ $\rho^{2} \le 1$ 이고, 양변에 $\sigma_{Y}^{2} = \Var (Y)$ 를 곱하면 $$ {{ \left[ k’(\theta) \right]^{2} } \over { n I (\theta) }} \le \Var (Y) $$

■

따름정리

만약 $k(\theta) = \theta$ 즉, $Y$ 가 불편추정량이면 $$ \begin{align*} & k(\theta) = \theta \\ \implies& k’(\theta) = 1 \\ \implies& \left[ k’(\theta) \right]^{2} = 1 \end{align*} $$ 이므로 $$ \Var (Y) \ge {{ 1 } \over { n I (\theta) }} $$

Hogg et al. (2013). Introduction to Mathematical Statistcs(7th Edition): p337. ↩︎

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!