편의-분산 트레이드 오프

정의

$$ \text{MSE} \left( \widehat{\theta} \right) = \Var \widehat{\theta} + \left( \text{Bias} \widehat{\theta} \right)^{2} $$

설명

평균제곱오차 $\text{MSE}$ 는 통계 모형의 평가나 머신 러닝에서의 손실 함수로써 즐겨쓰이는 척도로써, 특히 편의와 분산에 대한 트레이드 오프로 나타난다.통계학도에게 있어서 편의를 다루는 것은 다소 어색할지 모르겠다. 적절한 확률 분포를 가정하고 그에 따른 수학적 이론을 토대로 데이터를 다루는 입장에서 분산은 손에 잡힐듯이 친숙한 개념이지만, 편의의 제곱은 애초에 추정량과 참값의 괴리를 나타내므로 편의를 제어하지 못한다는 것은 잘못된 분석으로 이어지는 것으로 보이기 때문이다.

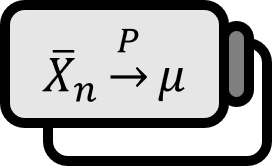

그러나 2021년 기준으로 보았을 때 최근에는 머신러닝 테크닉의 눈부신 발전이 있었으며, ‘예측’을 한다는 의미에서 편의가 커지는 것을 보상할 수 있을만큼 오차를 줄일 수 있는 기법이라면 기꺼이 사용할만한 시대가 되었다. 물론 분야에 따라 다르지만, 클래식한 통계기법보다도 머신러닝이 적극적으로 사용된다면 편의의 제어에 너무 집착하느라 퍼포먼스가 뛰어난 방법을 굳이 포기할 필요는 없다.(물론 백그라운드가 통계학이라면 이는 무척 못 미덥고 아니꼬울 것이다. 필자도 그러하다.)

증명

전략: 통계학에서는 자주 사용하는 방법이다. 기대값 내부의 괄호에서 $0 = E \widehat{\theta} - E \widehat{\theta}$ 를 찢어 여러 항으로 만든 다음 분산과 편의의 꼴로 정리한다.

$E \widehat{\theta} - \theta$ 는 상수이므로 $$ \begin{align*} \text{MSE} \left( \widehat{\theta} \right) =& E \left[ \left( \widehat{\theta} - \theta \right)^{2} \right] \\ =& E \left[ \left( \widehat{\theta} - E \widehat{\theta} + E \widehat{\theta} - \theta \right)^{2} \right] \\ =& E \left[ \left( \widehat{\theta} - E \widehat{\theta} \right)^{2} + 2 \left( \widehat{\theta} - E \widehat{\theta} \right) \left( E \widehat{\theta} - \theta \right) + \left( E \widehat{\theta} - \theta \right)^{2} \right] \\ =& E \left[ \left( \widehat{\theta} - E \widehat{\theta} \right)^{2} \right] + 2 E \left[ \left( \widehat{\theta} - E \widehat{\theta} \right) \left( E \widehat{\theta} - \theta \right) \right] + E \left[ \left( E \widehat{\theta} - \theta \right)^{2} \right] \\ =& \Var \widehat{\theta} + 2 E \left[ \left( \widehat{\theta} - E \widehat{\theta} \right) \left( E \widehat{\theta} - \theta \right) \right] + \left( E \widehat{\theta} - \theta \right)^{2} \\ =& \Var \widehat{\theta} + 2 E \left[ \left( \widehat{\theta} - E \widehat{\theta} \right) \right] E \left[ \left( E \widehat{\theta} - \theta \right) \right] + \left( \text{Bias} \widehat{\theta} \right)^{2} \\ =& \Var \widehat{\theta} + 2 \left( E \widehat{\theta} - E \widehat{\theta} \right) E \left[ \left( E \widehat{\theta} - \theta \right) \right] + \left( \text{Bias} \widehat{\theta} \right)^{2} \\ =& \Var \widehat{\theta} + 0 + \left( \text{Bias} \widehat{\theta} \right)^{2} \end{align*} $$

■

주의사항

한편 증명 과정에서 분산을 표현할 때 참값이 쓰이지 않은 것에 주목해보자. 평균제곱오차를 통해 추정량 $\widehat{\theta}$ 의 퍼포먼스를 평가할 때 그 분산은 딱히 참값을 잘 맞췄는지에 대한 지표가 되지 못하며, 막말로는 추정량이 진짜 추정량을 얼마나 잘 맞추는지만을 나타낸다.

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!