확률 변수들의 상호 독립과 iid

정의 1

- 확률 변수 $X_{1} , \cdots , X_{n}$ 가 다음을 만족하면 $X_{1} , \cdots , X_{n}$ 이 짝으로 독립pairwise independent이라 한다. $$ i \ne j \implies X_{i} \perp X_{j} $$

- 연속 확률 변수 $X_{1} , \cdots , X_{n}$ 의 조인트 확률 밀도 함수 $f$ 가 각각의 확률 밀도 함수 $f_{1} , \cdots , f_{n}$ 에 대해 다음을 만족하면 $X_{1} , \cdots , X_{n}$ 가 상호 독립이라 한다. $$ f(x_{1} , \cdots , x_{n} ) \equiv f_{1} (x_{1}) \cdots f_{n} (x_{n}) $$

- 이산 확률 변수 $X_{1} , \cdots , X_{n}$ 의 조인트 확률 질량 함수 $p$ 가 각각의 확률 밀도 함수 $p_{1} , \cdots , p_{n}$ 에 대해 다음을 만족하면 $X_{1} , \cdots , X_{n}$ 가 상호 독립이라 한다. $$ p(x_{1} , \cdots , x_{n} ) \equiv p_{1} (x_{1}) \cdots p_{n} (x_{n}) $$

- 확률 변수 $X_{1} , \cdots , X_{n}$ 가 상호 독립이고 같은 분포를 가지면 iidindependent and identically distributed라 말한다.

설명

- 짝으로 독립이라는 개념은 그 자체가 중요하다기보다는 상호 독립이라는 좋은 조건을 만족시키지 못하는, 안 좋은 조건이라는 뉘앙스가 강하다. 당연히 상호 독립이면 짝으로 독립이지만, 짝으로 독립이라고 상호 독립이 되지는 못한다. 이를 잘 보여주는 반례가 바로 번스타인 분포다.

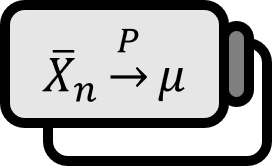

- iid는 상호 독립이 수식적으로 다루기 쉬우면서 그 각각이 같다는 점에서 수리통계학의 중요한 가정으로 즐겨 쓰인다. 가령 그 분포가 $D$ 라면 $X_{1} , \cdots , X_{n}$ 이 분포 $D$ 를 따르는 iid 확률 변수들이라 말하고 다음과 같이 나타내기도 한다. $$ X_{1} , \cdots , X_{n} \overset{\text{iid}}{\sim} D $$

정리

- [1] 기대값: $X_{1} , \cdots , X_{n}$ 이 상호 독립이면 각각에 대한 어떤 함수 $u_{1} , \cdots , u_{n}$ 에 대해 $$ E \left[ u_{1}(X_{1}) \cdots u_{n}(X_{n}) \right] = E \left[ u_{1}(X_{1}) \right] \cdots E \left[ u_{n}(X_{n}) \right] $$

- [2] 적률 생성 함수: $X_{1} , \cdots , X_{n}$ 가 상호 독립이고 각각의 적률 생성 함수가 $M_{i}(t) \qquad , -h_{i} < t < h_{i}$ 이면 그 선형 결합 $\displaystyle T := \sum_{i=1}^{n} a_{i} X_{i}$ 의 적률 생성 함수 $M_{T}$ 는 $$ M_{T} (t) = \prod_{i=1}^{n} M_{i} \left( a_{i} t \right) \qquad , -\text{min}_{i=1, \cdots, n} h_{i} < t < \text{min}_{i=1, \cdots, n} h_{i} $$

Hogg et al. (2013). Introduction to Mathematical Statistcs(7th Edition): p122~125. ↩︎

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!

저희들의 저서 「줄리아 프로그래밍」이 2024 세종도서 학술부문에 선정되었습니다!