ピアソン相関係数

定義 1

二つの確率変数 $X, Y$ に対して次のように定義される $\rho = \rho (X,Y)$ を ピアソン相関係数Pearson Correlation と呼ぶ。 $$ \rho = { {\operatorname{Cov} (X,Y)} \over {\sigma_X \sigma_Y} } $$

- $\sigma_{X}$, $\sigma_{Y}$ はそれぞれ $X$, $Y$ の標準偏差である。

説明

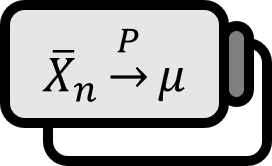

(ピアソン)相関係数(Pearson) Correlation coefficient は、二つの変数が互いに (線形)相関関係 を持っているかどうかを確認する尺度となる。$1$ または $–1$ に近ければ相関関係があると見なし、$0$ であればないと見なす。

注意すべきことは、相関関係と独立が同じ概念ではないということだ。相関関係はあくまで二つの変数が直線型のグラフを描くかどうかだけを確認する。相関関係がないからといって必ずしも独立であるとは限らない。しかし、独立であれば相関関係がないと言える。この逆が成り立つのは、二つの変数が正規分布に従うときだけである。

性質

ピアソン相関係数は $[-1,1]$ を外れない。すなわち、 $$ – 1 \le \rho \le 1 $$

証明

証明は二つの方法を紹介したい。

コーシー・シュワルツ不等式を用いた証明

$$ \rho = { {\operatorname{Cov} (X,Y)} \over {\sigma_X \sigma_Y} } = {1 \over n} \sum_{k=1}^{n} { \left( { { x_k - \mu_{X} } \over {\sigma_X} } \right) \left( { { y_k - \mu_{Y} } \over {\sigma_Y} } \right) } $$ 両辺を2乗すると $$ \rho ^2 = {1 \over {n^2} } \left\{ \sum_{k=1}^{n} { \left( { { x_k - \mu_{X} } \over {\sigma_X} } \right) \left( { { y_k - \mu_{Y} } \over {\sigma_Y} } \right) } \right\} ^ 2 $$

コーシー・シュワルツ不等式: $$ ({a}^{2}+{b}^{2})({x}^{2}+{y}^{2})\ge { (ax+by) }^{ 2 } $$

コーシー・シュワルツ不等式により $$ {1 \over {n^2} } \left\{ \sum_{k=1}^{n} { \left( { { x_k - \mu_{X} } \over {\sigma_X} } \right) \left( { { y_k - \mu_{Y} } \over {\sigma_Y} } \right) } \right\} ^ 2 \le {1 \over {n^2} } \sum_{k=1}^{n} { \left( { { x_k - \mu_{X} } \over {\sigma_X} } \right) ^ 2 } \sum_{k=1}^{n} { \left( { { y_k - \mu_{Y} } \over {\sigma_Y} } \right) ^ 2 } $$ 右辺を整理すると $$ \begin{align*} & {1 \over {n^2} } \sum_{k=1}^{n} { \left( { { x_k - \mu_{X} } \over {\sigma_X} } \right) ^ 2 } \sum_{k=1}^{n} { \left( { { y_k - \mu_{Y} } \over {\sigma_Y} } \right) ^ 2 } \\ =& {1 \over { {\sigma_X}^2 {\sigma_Y}^2 } } \sum_{k=1}^{n} { \left( { { x_k - \mu_{X} } \over { \sqrt{n} } } \right) ^ 2 \sum_{k=1}^{n} \left( { { y_k - \mu_{Y} } \over {\sqrt{n}} } \right) ^ 2 } \\ =& {1 \over { {\sigma_X}^2 {\sigma_Y}^2 } } {\sigma_X}^2 {\sigma_Y}^2 \\ =& 1 \end{align*} $$ $\rho ^2 \le 1$ であるから $$ -1 \le \rho \le 1 $$

■

共分散の定義を利用した証明

$\Var(Y)={ \sigma _ Y }^2, \Var(X)={ \sigma _ X }^2$, $\displaystyle Z= \frac { Y }{ \sigma _Y } - \rho \frac { X }{ \sigma _X }$ とおくと、共分散の定義に従って $$ \begin{align*} \Var(Z)&=\frac { 1 }{ { \sigma _ Y }^2 }\Var(Y)+\frac { { \rho ^ 2 } }{ { \sigma _ X }^2 }\Var(X)-2\frac { \rho }{ { \sigma _X } { \sigma _Y } }\operatorname{Cov}(X,Y) \\ =& \frac { 1 }{ { \sigma _ Y }^2 }{ \sigma _ Y }^2+\frac { { \rho ^ 2 } }{ { \sigma _ X }^2 }{ \sigma _ X }^2-2\rho \cdot \rho \\ &=1+{ \rho ^ 2 }-2{ \rho ^ 2 } \\ &=1-{ \rho ^ 2 } \end{align*} $$ $\Var(Z)\ge 0$ であるので $$ \begin{align*} 1-{ \rho ^ 2 }\ge 0 \implies& { \rho ^ 2 }-1\le 0 \\ \implies& (\rho +1)(\rho –1)\le 0 \\ \implies& -1\le \rho \le 1 \end{align*} $$

■

関連項目

Hogg et al. (2013). Introduction to Mathematical Statistcs(7th Edition): p104. ↩︎