カリン-ルビン定理の証明

定理

仮説検定:

$$ \begin{align*} H_{0} :& \theta \le \theta_{0} \\ H_{1} :& \theta > \theta_{0} \end{align*} $$

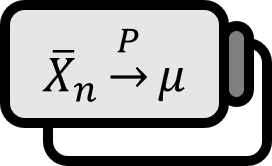

このような仮説検定では、$T$ を $\theta$ の十分統計量と言い、$t$ の確率密度関数または確率質量関数のファミリー$\left\{ g(t | \theta) : \theta \in \Theta \right\}$ が単調尤度比 MLR を持つとする。そうすると$\forall t_{0}$ に対して $$ H_{0} \text{ is rejected if and only if } T > t_{0} $$ の仮説検定はレベル $\alpha = P_{\theta_{0}} \left( T > t_{0} \right)$ 最強力検定だ。

- パラメーター$\theta$ に対して、棄却域が$R$ である関数$\beta (\theta) := P_{\theta} \left( \mathbf{X} \in \mathbb{R} \right)$ を 検出力関数power functionと言う。$\sup_{\theta \in \Theta_{0}} \beta (\theta) \le \alpha$ なら、与えられた仮説検定を レベルlevel $\alpha$ 仮説検定と言う。

説明

与えられた仮説検定は$H_{0} : \theta \le \theta_{0}$、つまり片側検定one-sided testに注意しよう。例えば、z-検定を行う場面で$|Z| \ge z_{\alpha/2}$ という条件下では帰無仮説を棄却することになるが、これは両側検定two-sided testであり、カーリン-ルービンの定理を無闇に使うことはできない。通常、片側で最強力検定であるが、他方でそうではなくなるという問題が発生し、この状況を克服するために偏りのない検定効率などを考えるようになる。

十分統計量の確率密度関数または確率質量関数のファミリーが単調尤度比を持つことを示すことで、片方向検定が最強力検定であることが保証される定理である。

証明 1

Part 1.

$\theta > \theta_{0}$ の時、帰無仮説は棄却されるため、検出力関数は$\beta (\theta) = P_{\theta} \left( T > t_{0} \right)$ となる。$\theta$ の十分統計量$T$ の確率密度関数または確率質量関数のファミリーが単調尤度比を持つという仮定より、$\beta \left( \theta \right)$ は単調増加関数(減少しない)であり $$ \sup_{\theta \le \theta_{0}} \beta \left( \theta \right) = \beta \left( \theta_{0} \right) = \alpha $$ であり、レベル$\alpha$のテストだ。

Part 2.

単調尤度比の定義: パラメーター$\theta \in \mathbb{R}$ と単変量確率変数$T$ に対する確率質量関数または確率密度関数のファミリーを$G := \left\{ g ( t | \theta) : \theta \in \Theta \right\}$ とする。全ての$\theta_{2} > \theta_{1}$ に対して $$ {{ g \left( t | \theta_{2} \right) } \over { g \left( t | \theta_{1} \right) }} $$ が$\left\{ t : g \left( t | \theta_{1} \right) > 0 \lor g \left( t | \theta_{2} \right) > 0 \right\}$ で単調関数ならば$G$ は 単調尤度比monotone Llikelihood Ratio, MLRを持つと言われる。

今$\theta ' >\theta_{0}$ を固定し、以下のように別の仮説検定を考える。 $$ \begin{align*} H'_{0} :& \theta = \theta_{0} \\ H'_{1} :& \theta = \theta ' \end{align*} $$ この新しい仮説検定はNeyman-Pearson補題の従題を適用するためのセッティングであり、同時に元の仮説検定の棄却域に属する$\theta ' \in \Theta_{0}^{c}$ に関する任意の仮説検定である。集合$\mathcal{T} := \left\{ t > t_{0} : g \left( t | \theta ' \right) \lor g \left( t | \theta_{0} \right) \right\}$ で $$ k ' := \inf_{t \in \mathcal{T}} {{ g \left( t | \theta ' \right) } \over { g \left( t | \theta_{0} \right) }} $$ を考えると、その定義に従って、以下を得る。 $$ T > t_{0} \iff {{ g \left( t | \theta ' \right) } \over { g \left( t | \theta_{0} \right) }} > k’ \iff g \left( t | \theta ' \right) > k’ g \left( t | \theta_{0} \right) $$

Part 3.

十分統計量を含む最強力検定: $$ \begin{align*} H_{0} :& \theta = \theta_{0} \\ H_{1} :& \theta = \theta_{1} \end{align*} $$

このような仮説検定で、パラメーター$\theta$ に対する十分統計量$T$ の$\theta_{0}, \theta_{1}$ に対する確率密度関数または確率質量関数を$g \left( t | \theta_{0} \right), g \left( t | \theta_{1} \right)$ と言おう。すると、棄却域$S$ とある定数$k \ge 0$ に対して、以下の三つの条件を満たしながら$T$ に依存する全ての仮説検定はレベル $\alpha$の最強力検定である。

- (i): $g \left( t | \theta_{1} \right) > k g \left( t | \theta_{0} \right)$ ならば $t \in S$

- (ii): $g \left( t | \theta_{1} \right) < k g \left( t | \theta_{0} \right)$ ならば $t \in S^{c}$

- (iii): $\alpha = P_{\theta_{0}} \left( T \in S \right)$

Part 2での条件 (i)、(ii)と、Part 1での条件 (iii)が満たされるので、$H'_{0} \text{ vs } H'_{1}$ は最強力検定である。言い換えると、全てのレベル$\alpha$ と$H'_{0}$ と比較した他の全ての検出力関数$\beta^{\ast}$ に対して $$ \beta^{\ast} \left( \theta ' \right) \le \beta \left( \theta ' \right) $$ が成り立つということであり、Part 1で$\beta$ が単調増加関数であったことと、Part 2で$\theta ' >\theta_{0}$ を固定したので、全ての仮説検定に対して$\beta \left( \theta_{0} \right) \le \alpha$ が適用されることがわかる。一方で、$H_{0}$ の全てのレベル$\alpha$ 仮説検定は $$ \beta^{\ast} \left( \theta_{0} \right) \le \sup_{\theta \in \Theta_{0}} \beta^{\ast} \left( \theta \right) \le \alpha $$ を満たす。証明過程で、$\theta '$ がレベル$\alpha$ の仮説検定であれば何でも良かったので、元の仮説検定のいかなる$\theta ' \in \Theta_{0}^{c}$ を代入しても、$H'_{0}$ だけでなく、$H_{0}$ の全てのレベル$\alpha$ 仮説検定で$\beta^{\ast} \left( \theta ' \right) \le \beta \left( \theta ' \right)$ が成り立つ。つまり、定理で与えられた$H_{0}$ の仮説検定はレベル$\alpha$ 最強力検定である。

■

Casella. (2001). Statistical Inference(2nd Edition): p391~392. ↩︎