十分統計量

定義

数式的な定義 1

パラメータ$\theta \in \Theta$に対するランダムサンプル$X_{1} , \cdots , X_{n}$の確率質量/密度関数を$f(x;\theta)$、統計量$Y_{1} := u_{1} \left( X_{1} , \cdots , X_{n} \right)$の確率質量/密度関数を$f_{Y_{1}} \left( y_{1}; \theta \right)$とする。

$\theta \in \Theta$に依存しない$H \left( x_{1} , \cdots , x_{n} \right)$に対して $$ {{ f \left( x_{1} ; \theta \right) \cdots f \left( x_{n} ; \theta \right) } \over { f_{Y_{1}} \left( u_{1} \left( x_{1} , \cdots, x_{n} \right) ; \theta \right) }} = H \left( x_{1} , \cdots , x_{n} \right) $$ であれば、$Y_{1}$を$\theta$に対する十分統計量という。

一般的な定義 2

統計量$T(\mathbf{X})$が、与えられたサンプルの$\mathbf{X}$条件付き確率分布がパラメータ$\theta$に依存しない場合、$T(\mathbf{X})$を$\theta$に対する十分統計量という。

説明

定義の数式が意味するのは、直感的に見ると、分子と分母で$\theta$がキャンセルされること―つまり十分統計量$Y_{1}$が、ランダムサンプル$X_{1} , \cdots , X_{n}$の情報を正確に保持しているという意味になるだろう。十分統計量の「十分」とは、$\theta$に関する情報が「十分」に与えられていると受け取れば良く、十分統計量を除いた後は、$\theta$に関する情報が全く残ってはいけない。

十分統計量を理解するために、以下の定理を用いよう。

ネイマン分解定理: ランダムサンプル$X_{1} , \cdots , X_{n}$が、パラメータ$\theta \in \Theta$に対して同じ確率質量/密度関数$f \left( x ; \theta \right)$を持つとする。統計量$Y = u_{1} \left( X_{1} , \cdots , X_{n} \right)$が$\theta$の十分統計量であるためには、次を満たす非負の二つの関数$k_{1} , k_{2} \ge 0$が存在することである。 $$ f \left( x_{1} ; \theta \right) \cdots f \left( x_{n} ; \theta \right) = k_{1} \left[ u_{1} \left( x_{1} , \cdots , x_{n} \right) ; \theta \right] k_{2} \left( x_{1} , \cdots , x_{n} \right) $$ ただし、$k_{2}$は$\theta$に依存してはならない。

響かない例

$$ X_{1} , \cdots , X_{n} \sim N \left( \mu , \sigma^{2} \right) $$

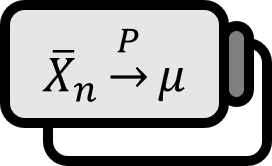

経験的に、十分統計量は、なぜそんなものを計算するのか、理解することから始める必要がある。典型的に響かない例として、正規分布$N \left( \mu , \sigma^{2} \right)$の母平均$\mu$に対する十分統計量を見ることだ。分解定理によれば、$\mu$の十分統計量は $$ \begin{align*} \prod_{k=1}^{n} f \left( x_{k} ; \mu \right) =& \prod_{k=1}^{n} {{ 1 } \over { \sigma \sqrt{2 \pi} }} \exp \left( - {{ \left( x_{i} - \mu \right)^{2} } \over { 2 \sigma^{2} }} \right) \\ =& \left( {{ 1 } \over { \sigma \sqrt{2 \pi} }} \right)^{n} \exp \left( - \sum_{k=1}^{n} {{ \left( x_{i} - \mu \right)^{2} } \over { 2 \sigma^{2} }} \right) \\ =& \left( {{ 1 } \over { \sigma \sqrt{2 \pi} }} \right)^{n} \exp \left( - \sum_{k=1}^{n} {{ x_{i}^{2} } \over { 2 \sigma^{2} }} \right) \exp \left( - \sum_{k=1}^{n} {{ \left( 2 x_{i} - \mu^{2} \right) } \over { 2 \sigma^{2} }} \right) \\ =& \left( {{ 1 } \over { \sigma \sqrt{2 \pi} }} \right)^{n} \exp \left( - \sum_{k=1}^{n} {{ x_{i}^{2} } \over { 2 \sigma^{2} }} \right) \cdot \exp \left( - {{ 1 } \over { \sigma^{2} }} \sum_{k=1}^{n} x_{i} + {{ n(\mu/\sigma)^{2} } \over { 2 \ }} \right) \\ =& k_{2} \left( x_{1} , \cdots , x_{n} \right) \cdot k_{1} \left[ u_{1} \left( x_{1} , \cdots , x_{n} \right) ; \mu \right] \end{align*} $$ であり、サンプル和$\sum_{k=1}^{n} X_{k}$であろうと、分子分母に$n$を掛けてサンプル平均$\overline{X}$になろうと、関係ない。直感に従って、$\mu$の十分統計量として、その不偏推定量であり、一致推定量であり、最尤推定量でもあるサンプル平均が出てきたのは良い。数式的には理解できる。しかし、それが一体何を意味するのか、感じることは難しいだろう。

響く例

$$ X_{1} , \cdots , X_{n} \sim U (0,\theta) \text{ with } f \left( x ; \theta \right) = \begin{cases} 1 & , \text{if } x \in (0,\theta) \\ 0 & , \text{otherwise} \end{cases} = {{ 1 } \over { \theta }} I_{(0,\theta)} (x) $$

例えば、最大値のパラメータが$\theta$である一様分布から得られたランダムサンプルを考えてみよう。実際の実現が $$ \begin{bmatrix}2.3 \\ 1.2 \\ 1.7 \\ 0.1 \\ 1.1\end{bmatrix} $$ であり、これ以上のサンプルを得られない場合、一様分布$U(a,b)$の母平均が${{ b+a } \over { 2 }}$であるため、次のような推定量を考えることができる。 $$ {{ \hat{\theta} + 0 } \over { 2 }} = {{ \sum_{k} x_{k} } \over { n }} \implies \hat{\theta} \overset{?}{=} {{ 2 \sum_{k} x_{k} } \over { n }} $$ 数理統計学的にそんなに悪くない推測のようだ。実際、このデータで計算されたサンプル平均の$2$倍は$2.16$で、かなりもっともらしい。しかし、$2.3$がサンプルにあることを考えると、$\theta = 2.16$であるはずがない。どう考えても、$\theta$は$2.3$以上でなければならず、直感的に見て、$\theta$に対する合理的な推定は、単純に$\hat{\theta} = 2.3$になる。今のサンプルを見たとき、$2.3$より大きいと考える理由が全くないからだ。さあ、実際に十分統計量を探してみよう。

指示関数の積: $$ \prod_{i=1}^{n} I_{(-\infty, \theta]} \left( x_{i} \right) = I_{(-\infty, \theta]} \left( \max_{i \in [n]} x_{i} \right) $$

この補題と分解定理により考えると、$\theta$に対する十分統計量は $$ \begin{align*} \prod_{k=1}^{n} f \left( x_{k} ; \mu \right) =& \prod_{k=1}^{n} {{ 1 } \over { \theta }} I_{(0,\theta)} \left( x_{k} \right) \\ = & {{ 1 } \over { \theta^{n} }} I_{(0,\theta)} \left( \max x_{k} \right) \cdot 1 \\ = & k_{1} \left[ u_{1} \left( x_{1} , \cdots , x_{n} \right) ; \theta \right] k_{2} \left( x_{1} , \cdots , x_{n} \right) \end{align*} $$ であるため、サンプルの最大値$\max_{k} X_{k} = X_{(n)}$が十分となる。これが意味するのは、$\theta$に関する情報を考えるとき、他のサンプルは必要なく、$\max_{k} X_{k}$だけを考えれば「十分」であるということだ。

このアイデアは、データをたくさん引き出してパラメータを推定し、それをどこかに近似する考え方とは全く異なる。これは、直感的な推測に対して、数学と形式でアプローチする統計的推論であり、これを通じて、統計学のさらに深い世界に入れる。

最小十分統計量

響く例で、$\max_{k} X_{k}$が$\theta$に対する十分統計量であることを直感と照らし合わせて確認した。これ以上の十分統計量はないと見えるが、最小十分統計量に関する議論がその答えとなるだろう。