数理統計学における損失関数と危険関数

導入1

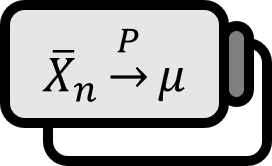

サイズが $n$ の サンプル の 確率変数 を $X$ とする。 またこのサンプルが 確率密度関数 $p(x; \theta)$ に従う分布から得られたとする。 パラメータ $\theta$ の 推定量 を $\phi(X)$ のように表す。

推定量の役割はパラメータ $\theta$ をよく近似することなので、両者の誤差を測る関数を考えるのが自然だ。 また差を測るので、その関数値は非負であるのが妥当だ。 したがって、両者の差を表す関数 $\mathcal{L}$ を下記のように定義する。

定義

パラメータ $\theta$ とそのパラメータの推定量 $\phi(X)$ に対する関数 $\mathcal{L}$ を 損失関数loss function と呼ぶ。

$$ \mathcal{L} : (\theta, \phi(X)) \mapsto \mathcal{L}(\theta, \phi(X)) \in \mathbb{R}^{+} $$

ここで $\mathbb{R}^{+} = \left\{ x \in \mathbb{R} : x \gt 0 \right\}$ である。 損失関数の 期待値 を リスク関数risk function と呼ぶ。

$$ R(\theta, \phi(X)) = E_{X}\left[ \mathcal{L}(\theta, \phi(X)) \right] = \int \mathcal{L}(\theta, \phi(x)) p(x; \theta) \mathrm{d}x $$

説明

推定量 $\phi(X)$ を選ぶたびにパラメータとの差である $\mathcal{L}$ が定まるため、この文脈では推定量を 決定関数decision function と呼ぶこともある。 このときは通常 decision の頭文字を取って $\delta(X)$ と表記する。

$$ R(\theta, \delta) = E_{X} \left[ \mathcal{L}(\theta, \delta(X)) \right] = \int \mathcal{L}(\theta, \delta(X)) p(x; \theta) \mathrm{d}x $$

定義から損失関数はその形が明確に定まっていない点に注意する。 損失関数はどのように定義してもよいが、損失関数が良く機能するためにはパラメータと推定量の隔たりを適切に反映し、計算上の利点があるなど様々な観点から検討する必要がある。 このような文脈ではリスク関数が損失関数を選ぶ上で重要な基準となるが、すべての $\theta$ に対して $R(\theta, \phi(X))$ が最小になるような損失関数を選ぶのが望ましい方法だろう。

頻度主義者frequencyist, 頻度主義者 の観点ではパラメータ $\theta$ は固定された一つの値だが、ベイズの観点ではパラメータ $\theta$ は確率変数として扱われる。 すると ベイズ推論におけるリスク関数 は 結合分布 に関する期待値に変わる。

$$ R(\Theta, \phi(X)) = E_{\Theta, X} \left[ \mathcal{L}(\Theta, \phi(X)) \right] = \int \int \mathcal{L}(\theta, \phi(x)) p(\theta, x) \mathrm{d}\theta \mathrm{d}x $$

平均二乗誤差

以下のようなリスク関数を 平均二乗誤差mean squared error と呼ぶ。

$$ R(\theta, \phi(X)) = E_{X} \left[ \big( \theta - \phi(X) \big)^{2} \right] = \int \big( \theta - \phi(X) \big)^{2} p(x; \theta)\mathrm{d}x $$

意味は名前の逆に理解すればよい。 誤差二乗の平均である。

関連項目

Hogg et al. (2013). Introduction to Mathematical Statistcs(7th Edition): p376. ↩︎