数理統計学における期待値、平均、分散、モーメントの定義

定義: 期待値、平均、分散

確率変数 $X$ が与えられたとする。

連続確率変数$X$ の確率密度関数$f(x)$ が $\displaystyle \int_{-\infty}^{\infty} |x| f(x) dx < \infty$ を満たす場合、以下のように定義された $E(X)$ を$X$ の期待値expectationと言う。 $$ E(X) := \int_{-\infty}^{\infty} x f(x) dx $$

離散確率変数$X$ の確率質量関数$p(x)$ が $\displaystyle \sum_{x} |x| p(x) < \infty$ を満たす場合、以下のように定義された $E(X)$ を$X$ の期待値expectationと言う。 $$ E(X) := \sum_{x} x p(x) $$

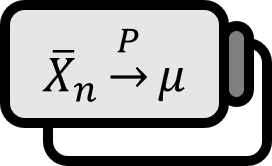

$\mu = E(X)$ が存在する場合、$X$ の 平均meanと定義する。

$\sigma^2 = E((X - \mu)^2)$ が存在する場合、$X$ の 分散varianceと定義する。

抽象化の意味

統計学を簡単な言葉で一言で言い表すなら、「だから平均的にどうなの?」を研究する学問だと言えるかもしれない。「平均」は代表値としてかなり直感的で、計算も簡単な統計量である。しかし、この世にある様々な現象を説明するには、そんな単純なレベルでは足りず、「期待値」という形で抽象化される。期待値は離散分布だけでなく区分求積法の発想を借りて連続分布にも対応する概念となる。この文章で議論するのはまさにその「抽象化」についての話である。

数理統計学は確かに統計理論に関する内容を含んでいるが、学問の性質を見たとき、本質的には数学の一分野に近い。従って、他の数学の分野のように数学者と同じマインドセットで数理統計学を理解しようとする努力が必要である。数学者の仕事の一つは、直感や既に世に出ている理論と矛盾せず、厳格な定義を考案して、万物、対象物、現象、またそれらを超えたすべてを記号に変え、そのすべてをその場で研究できるようにすることである。

平均と分散の定義を見ると、直感的な意味は全く残っておらず、単に確率変数に期待値を取った形で表されている。定義からこれらがどのように平均や実際につながるか、どのように分散と実際につながるかには関心がない。むしろ、平均と分散という概念を当たり前のように受け入れているほど習熟した学習者が、記号に逆らって適応することが期待される。実際、数理統計学を学ぶレベルの学習者であれば、それらの定義に大きな疑問を持つことはないだろう。

平均の抽象化と期待値という概念が定着すると、学者たちはより多くの可能性を発見する。単純な合計や積分といった限界を超え、基本的な代数学や解析学の理論を導入してこれらを扱い始めたのである。自然と、学者たちの関心は抽象化から一般化へと移行する。

定義: モーメント

自然数 $m$ に対して、$E( X^m )$ を$X$ の**$m$番目のモーメント**$m$th Momentと定義する。

一般化の意味

モーメントの定義を読むだけで即座に分かる事実は、第一モーメント、つまり$E(X^1)$ が$X$ の平均になるということである。もう少し考えると、第二モーメントである$E(X^2)$ も少しの操作を通じて分散になることもわかる。

平均は第一モーメント、分散は第二モーメントと実質的に同じ概念と見ることができる。逆に考えれば、モーメントの中で第一が平均に対応し、第二が分散に対応すると言えるだろう。

それでは、直感を持つ学者はもちろん、第三や第四のモーメントも何か重要な情報を与えることができるだろうと推測することになる。[ NOTE: 具体的には、これを歪度、尖度と言う。] 今では研究の方向性が逆転し、明らかになった事実を理論で説明するのではなく、理論で隠された事実を見つけ出そうとするものになっている。

このような方法論は、統計学だけでなく、自然科学全般で容易に見ることができる。数理統計学は統計よりも数学に近いといえるが、学問の存在意義に近づくと再び統計学の姿を取り戻す。モーメントmomentという言葉自体は物理学などでも使用されるが、統計学ではモーメントがどのような意味を持つか考える必要はない。ただ、数理統計学を支える理論を説明する際に使用する言葉として知っておけば十分である。

一方で、期待値の存在条件である$\displaystyle \int_{-\infty}^{\infty} |x| f(x) dx < \infty$、つまり$x$ でわざわざ絶対値を取る必要があるのか疑問に思うかもしれない。存在を保証することと具体的な値を計算することは別としても、$X$ の期待値$E(X)$ は別の式を使う必要がないように見えるからである。

この点については、次の定理を見れば少しは役立つかもしれない。最も単純な$X$ の議論ではなく、$g(X)$ への一般化まで考慮すると、むしろ$E(X)$ こそ恒等関数 $g(x) = x$ に対する特別なケースとして定義されたと見ることもできるだろう。

定理

確率変数$X$ について、$Y$ が何らかの関数$g$ に対して$Y := g(X)$ のように表れるとする。

- [1]: $X$ が確率密度関数$f_{X}$ を持つ連続確率変数で、$\displaystyle \int_{-\infty}^{\infty} |g(x)| f_{X} (x) dx < \infty$ を満たす場合、 $$ E (Y) = \int_{-\infty}^{\infty} g(x) f_{X} (x) dx $$

- [2]: $X$ が確率質量関数$p_{X}$ を持つ離散確率変数で、$\displaystyle \sum_{x} |g(x)| p_{X} (x) < \infty$ を満たす場合、 $$ E (Y) = \sum_{x} g(x) p_{X} (x) $$