スチューデントのt検定の証明

定理 1

確率変数 $X_{1} , \cdots , X_{n}$ がiidで正規分布 $N\left( \mu,\sigma^{2} \right)$ に従うとすると

- (a): $$ \overline{X} \sim N\left( \mu , { {\sigma^2} \over {n} } \right) $$

- (b): $$ \overline{X} \perp S^2 $$

- (c): $$ (n-1) { {S^2} \over {\sigma^2} } \sim \chi^2 (n-1) $$

- (d): $$ T = { {\overline{X} - \mu } \over {S / \sqrt{n}} } \sim t(n-1) $$

- 標本平均 $\overline{X}$ と 標本分散 $S^{2}$ は、次のように定義される確率変数だ。

$$ \overline{X} := {{ 1 } \over { n }} \sum_{k=1}^{n} X_{k} \\ S^{2} := {{ 1 } \over { n-1 }} \sum_{k=1}^{n} \left( X_{k} - \overline{X} \right)^{2} $$

説明

統計学をする人たちは当たり前のように使っているけど、事実これにも名前がある。四つのパートに分けられていて、具体的に引用するのも難しい。

(b)は、標本平均でも標本分散でも、同じデータから出ているにもかかわらず、独立であるというのがそう。

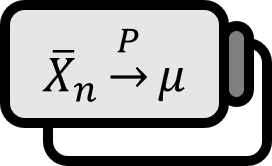

小標本に対する母平均の推定

スチューデントの定理の証明は小標本での母平均に対する仮説検定の導出そのものだ。

証明

(a)

$\displaystyle \overline{X} = { { (X_1 + X_2 + \cdots + X_n )} \over {n}}$ なので、正規分布に従う確率変数の和を考えた場合 $$ \overline{X} \sim N \left( \mu, {{1} \over {n}} \sigma^2 \right) $$

■

(b)

- $\mathbf{0}$ はゼロベクトルを示す。

- $\mathbf{1} = (1, \cdots , 1) = \begin{bmatrix} 1 \\ \vdots \\ 1 \end{bmatrix}$ はすべての成分が$1$ であるベクトルを示す。

- $I$ は単位行列を示す。

- $A^{T}$ は行列$A$の転置行列を示す。

$\displaystyle \mathbf{v} := {{ 1 } \over { n }} \mathbf{1}$ とする。

ランダムベクトル $X := \left( X_{1} , \cdots , X_{n} \right)$ は多変量正規分布に従い $$ \begin{align*} \overline{X} =& {{ 1 } \over { n }} \left( X_{1} + \cdots + X_{n} \right) \\ &= {{ 1 } \over { n }} \begin{bmatrix} 1 & \cdots & 1 \end{bmatrix} \begin{bmatrix} X_{1} \\ \vdots \\ X_{n} \end{bmatrix} \\ =& {{ 1 } \over { n }} \mathbf{1}^{T} \mathbf{X} \\ =& \mathbf{v}^{T} \mathbf{X} \end{align*} $$

今、ランダムベクトル $\mathbf{Y} := \left( X_{1} - \overline{X} , \cdots , X_{n} - \overline{X} \right)$ を定義すれば、あるランダムベクトル $\mathbf{W}$ は次のように表せる。 $$ \mathbf{W} = \begin{bmatrix} \overline{X} \\ \mathbf{Y} \end{bmatrix} = \begin{bmatrix} \mathbf{v}^{T} \\ I - \mathbf{1} \mathbf{v}^{T} \end{bmatrix} \mathbf{X} $$

$\mathbf{W}$ は多変量正規分布に従うランダムベクトルが線形変換されたものなので、やはり多変量正規分布に従い、その母平均ベクトルは上の式に期待値を取った $$ E \mathbf{W} = \begin{bmatrix} \mathbf{v}^{T} \\ I - \mathbf{1} \mathbf{v}^{T} \end{bmatrix} \mu \mathbf{1} = \begin{bmatrix} \mu \\ \mathbf{0}_{n} \end{bmatrix} $$ であり、共分散行列 $\Sigma$ は $$ \begin{align*} \Sigma =& \begin{bmatrix} \mathbf{v}^{T} \\ I - \mathbf{1} \mathbf{v}^{T} \end{bmatrix} \sigma^{2} I \begin{bmatrix} \mathbf{v}^{T} \\ I - \mathbf{1} \mathbf{v}^{T} \end{bmatrix}^{T} \\ =& \sigma^{2} \begin{bmatrix} 1/n & \mathbf{0}_{n}^{T} \\ \mathbf{0}_{n} & I - \mathbf{1} \mathbf{v}^{T} \end{bmatrix} \end{align*} $$ である。ここで、$\overline{X}$ は$\mathbf{Y}$ と独立であることがわかり $$ S^{2} = {{ 1 } \over { n-1 }} \sum_{k=1}^{n} \left( X_{k} - \overline{X} \right)^{2} = {{ 1 } \over { n-1 }} \mathbf{Y}^{T} \mathbf{Y} $$ したがって、$\overline{X} \perp S^{2}$ である。

■

(c)

$\displaystyle V = \sum_{i=1}^{n} \left( { {X_{i} - \mu } \over {\sigma} } \right) ^2 $とした場合 $\displaystyle { {X_{i} - \mu } \over {\sigma} } \sim N(0,1)$なので$V \sim \chi^2 (n)$であるとし

$$ \begin{align*} V =& \sum_{i=1}^{n} \left( { {X_{i} - \mu } \over {\sigma} } \right) ^2 \\ =& \sum_{i=1}^{n} \left( { { ( X_{i} -\overline{X} ) + ( \overline{X} - \mu ) } \over {\sigma} } \right) ^2 \\ =& \sum_{i=1}^{n} \left( { { X_{i} -\overline{X} } \over {\sigma} } \right) ^2 + \left( { { \overline{X} - \mu } \over {\sigma / \sqrt{n} } } \right) ^2 \end{align*} $$

ここで $$ \sum_{i=1}^{n} \left( { { X_{i} -\overline{X} } \over {\sigma} } \right) ^2 = { {n-1} \over {\sigma^2} } \sum_{i=1}^{n} { { ( X_{i} -\overline{X} ) ^ 2 } \over {n-1} } = (n-1) { {S^2} \over {\sigma^2} } $$

整理すると $$ V = (n-1) { {S^2} \over {\sigma^2} } + \left( { { \overline{X} - \mu } \over {\sigma / \sqrt{n} } } \right) ^2 $$

$V \sim \chi^2 (n)$ であり、スチューデントの定理の(a)により $$ \left( { { \overline{X} - \mu } \over {\sigma / \sqrt{n} } } \right) \sim N(0,1) $$ であり、標準正規分布の二乗はカイ二乗分布に従うので $$ \left( { { \overline{X} - \mu } \over {\sigma / \sqrt{n} } } \right)^2 \sim \chi^2 (1) $$

スチューデントの定理の(b)で、$\overline{X}$ と $S^2$ が独立であることが示されたので、両辺をモーメント生成関数として $$ (1-2t)^{-n/2} = E \left\{ \exp \left( (n-1) { {S^2} \over {\sigma^2} } t \right) \right\} (1-2t)^{-1/2} $$

したがって、$\displaystyle (n-1) { {S^2} \over {\sigma^2} }$のモーメント生成関数は$(1-2t)^{-(n-1)/2}$である。

■

(d)

正規分布とカイ二乗分布からスチューデントのt分布の導出: $W \sim N(0,1)$が真であり、$V \sim \chi^2 (r)$ならば $$ T = { {W} \over {\sqrt{V/r} } } \sim t(r) $$

$$ T = { {\overline{X} - \mu } \over {S / \sqrt{n}} } = { {( \overline{X} - \mu ) / (\sigma / \sqrt{n}) } \over { \sqrt{ (n-1) S^2 / ( \sigma^2 ( n-1 ) ) } } } $$ スチューデントの定理の(a)で$\displaystyle \overline{X} \sim N\left( \mu , { {\sigma^2} \over {n} } \right) $が、(c)で$\displaystyle (n-1) { {S^2} \over {\sigma^2} } \sim \chi^2 (n-1) $であることが示されたので、 $$ T \sim t(n-1) $$

■

Hogg et al. (2013). Introduction to Mathematical Statistcs(7th Edition): p195. ↩︎